[ Business ]

« Dans les prochaines années, le marché du cloud…

OFFRES FREELANCE

Les attaques DDoS s’imposent comme des outils de cyberguerre de…

“Les conclusions de cette enquête montrent comment les cyberattaquants exploitent des moments de vulnérabilité nationale pour amplifier le chaos et éroder la confiance accordée aux institutions en visant les infrastructures…

Nouvelle série Galaxy Tab S10 FE, des tablettes polyvalentes

Samsung propose les Galaxy Tab S10 FE et Tab S10 FE+, deux tablettes haut de gamme, à la taille fine et aux fonctionnalités intelligentes. La Galaxy Tab S10 FE+ possède…

Premier bilan positif pour 17Cyber, guichet unique des menaces numériques

(AFP) – Moins de quatre mois après son lancement, le guichet unique des menaces en ligne, 17Cyber, a permis d’assister près de 140 000 personnes, a déclaré mardi le directeur…

Christine Lagarde alerte sur “le pouvoir transformateur de l’IA” sur…

“Nous pouvons déjà constater les effets de l’IA sur la productivité dans des secteurs comme celui technologique américain, où la production augmente tandis que l’emploi diminue“, s’est inquiétée Christine Lagarde,…

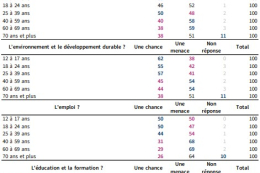

L’usage de l’IA est plus fréquent dans la sphère privée…

Un tiers des Français déclarent avoir utilisé des outils d’IA en 2024. C’est une hausse de 13 points par rapport à 2023, selon le dernier Baromètre du numérique réalisé par…

Un nouveau directeur général pour SCC France qui vise 50…

Ce spécialiste des services informatiques, qui fête ses 50 ans cette année, annonce la nomination de Gaël Menu au poste de directeur général. Ce dernier remplace Didier Lejeune. Gaël Menu…

SUIVRE TOUTE L'ACTUALITÉ

Nouvelle série Galaxy Tab S10 FE, des tablettes polyvalentes

Samsung propose les Galaxy Tab S10 FE et Tab S10 FE+, deux tablettes haut de gamme, à la taille fine et aux fonctionnalités intelligentes. La Galaxy Tab S10 FE+ possède un écran 13,1’’2 (près de 12 % plus grand que le modèle précédent) avec un…